在 Ubuntu 上使用 Ollama 部署 DeepSeek R1

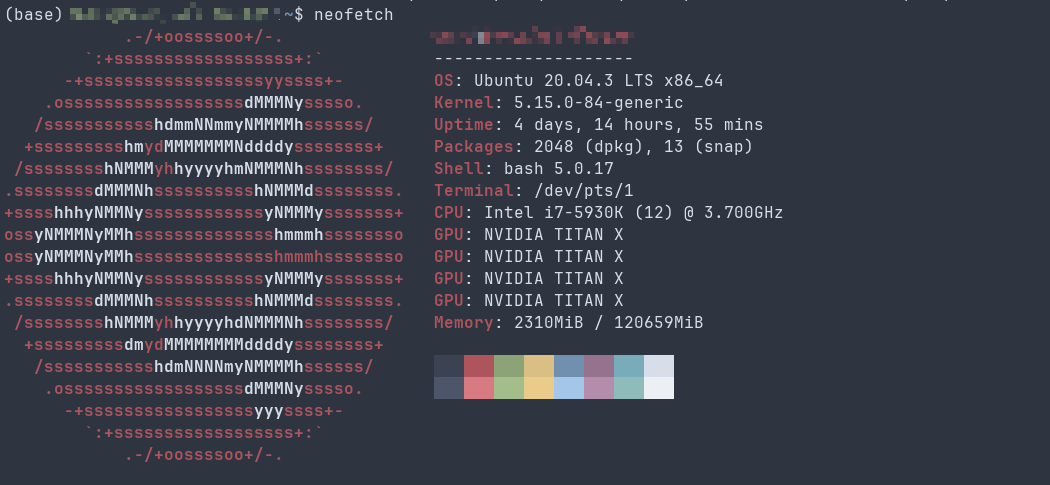

一、机器配置

二、安装 Ollama

2.1 Ollama 介绍

Ollama 安装简单,使用方便,核心目标就是让用户无需依赖云服务即可在本地运行大模型,所有数据处理都在本地完成,确保隐私安全;而且 Ollama 也是轻量级的,可以自动检测本地硬件,优先用 GPU 推理加速,如果无 GPU 就会使用 CPU;而且 Ollama 支持多个模型,只需要简单的 run 命令就可以完成大模型的本地部署工作。

2.2 安装

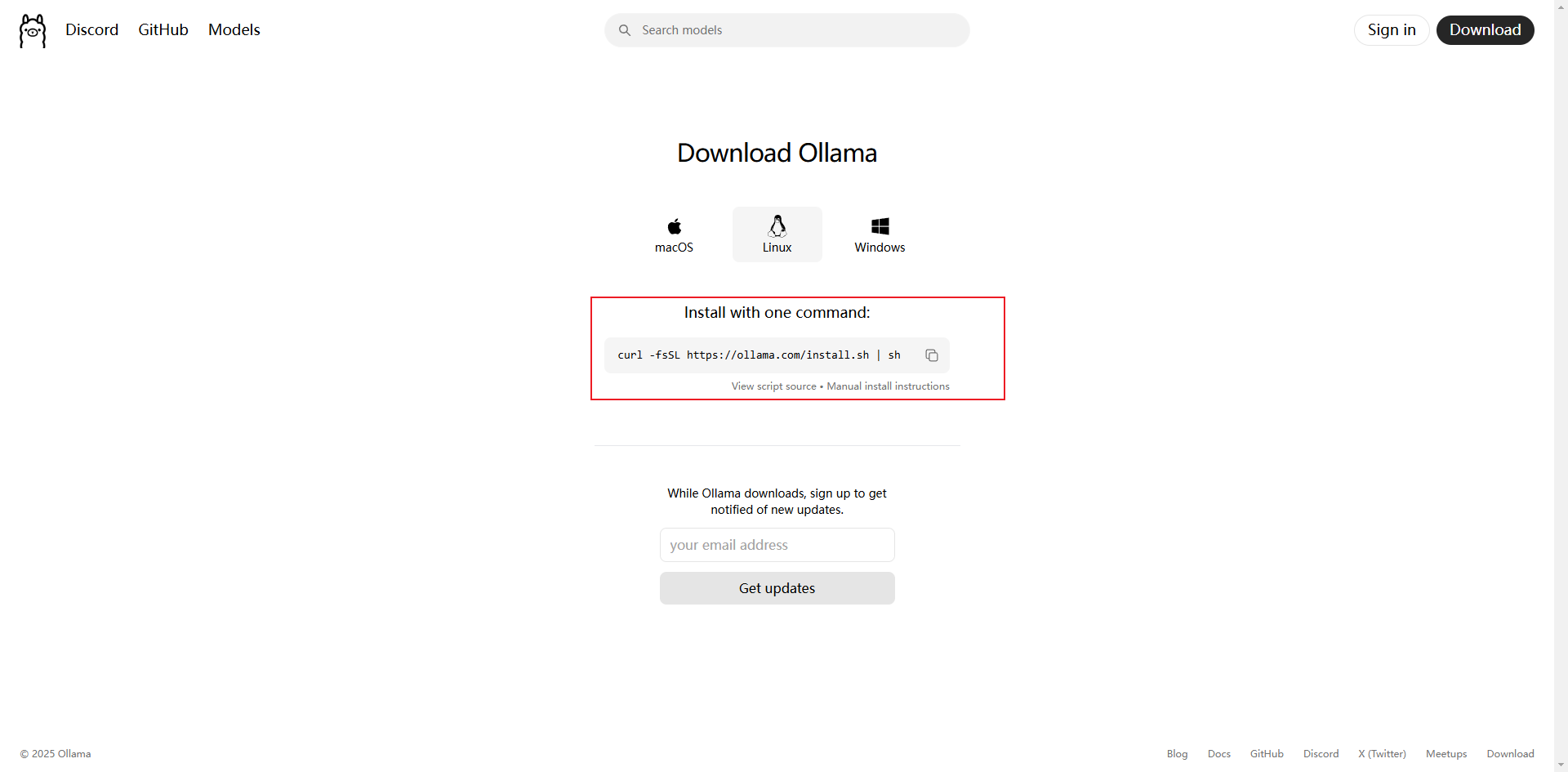

访问官网:https://ollama.com/download/linux

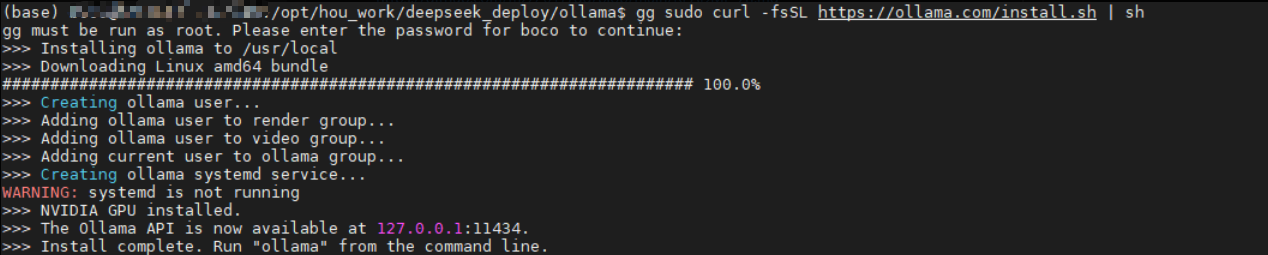

在终端执行官网上的命令即可完成安装,安装完成后如下图所示:

注:gg(https://github.com/mzz2017/gg) 是使用的命令行代理工具,可以使用代理改善网络状况

三、安装 DeepSeek R1

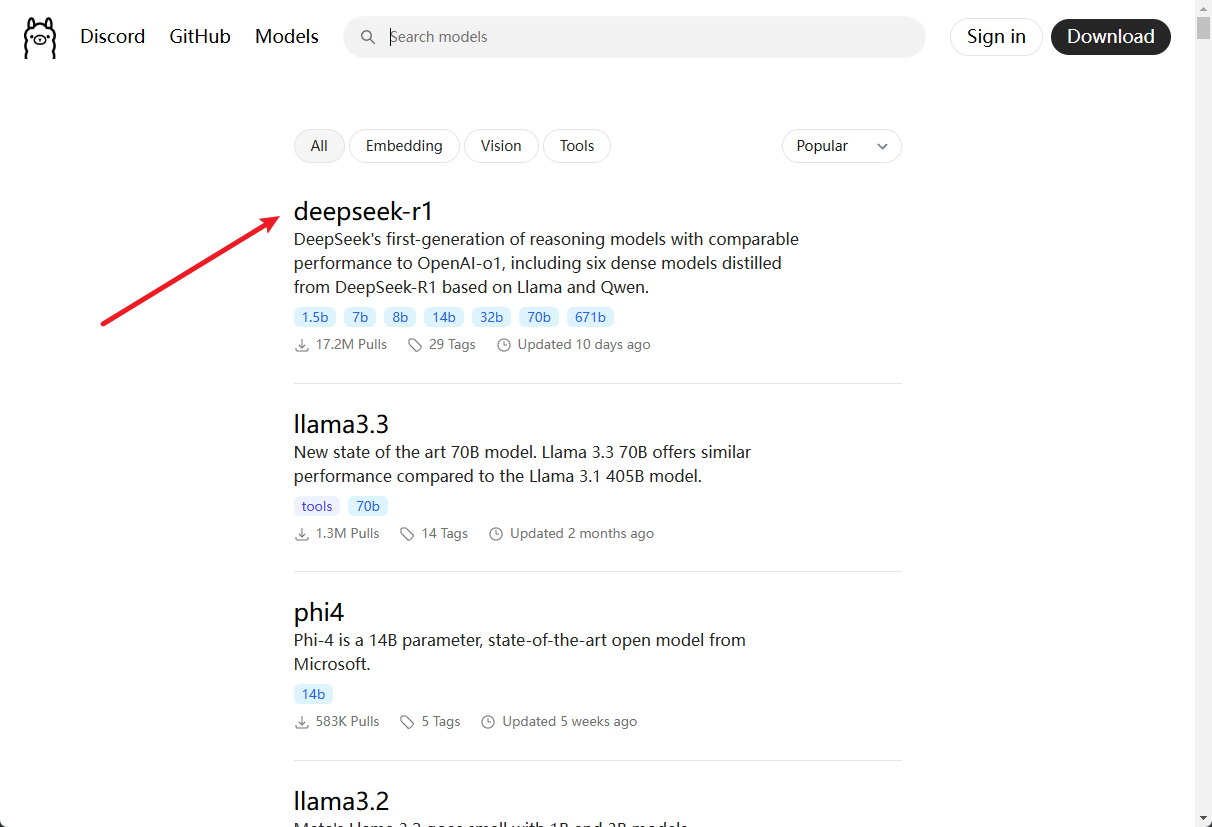

在 Ollama 官网首页,点击 Models

然后点击 deepseek-r1

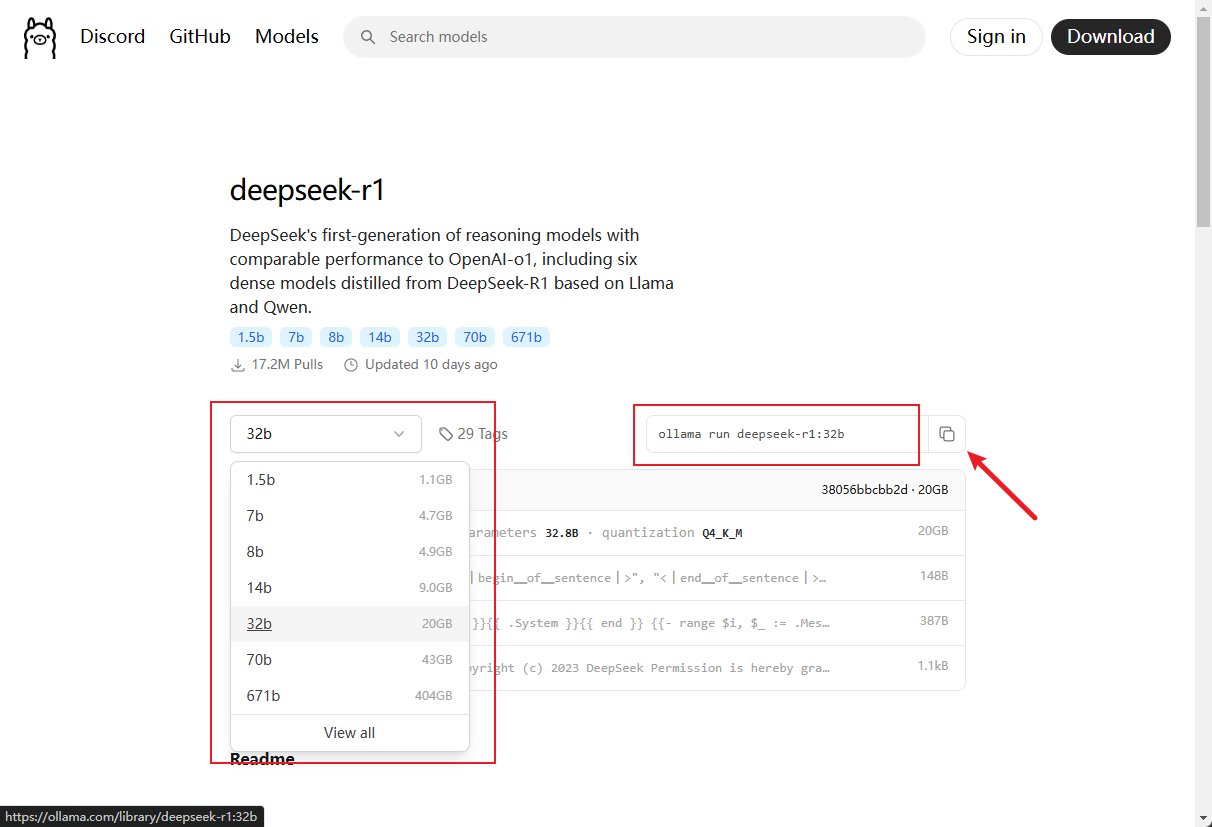

根据自己的实际配置情况,选择部署模型的版本,然后点击右侧的复制按钮,复制到终端命令行执行

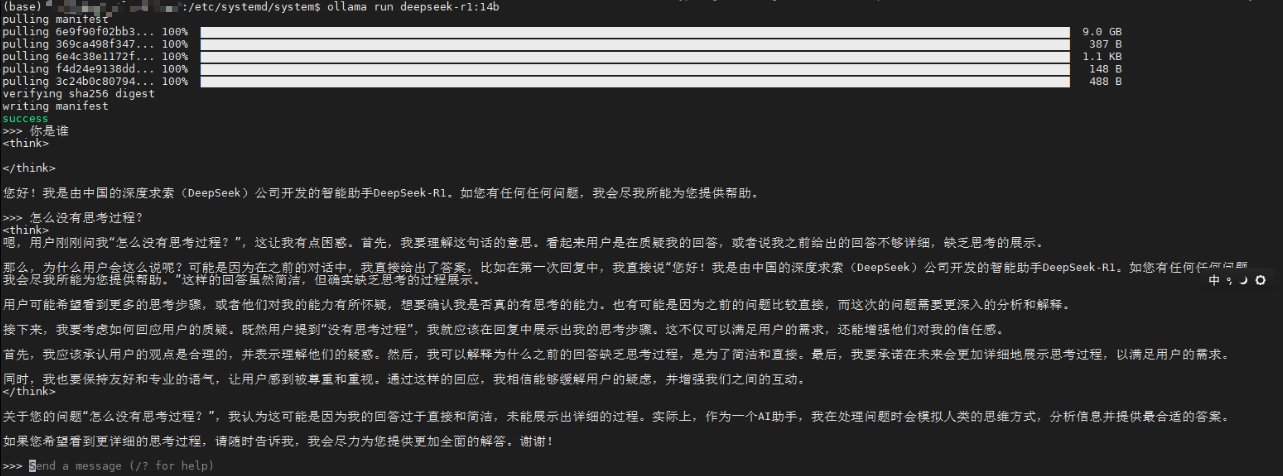

执行等待模型文件下载完成后,就可以给模型发送消息,进行测试了

四、遇到的问题

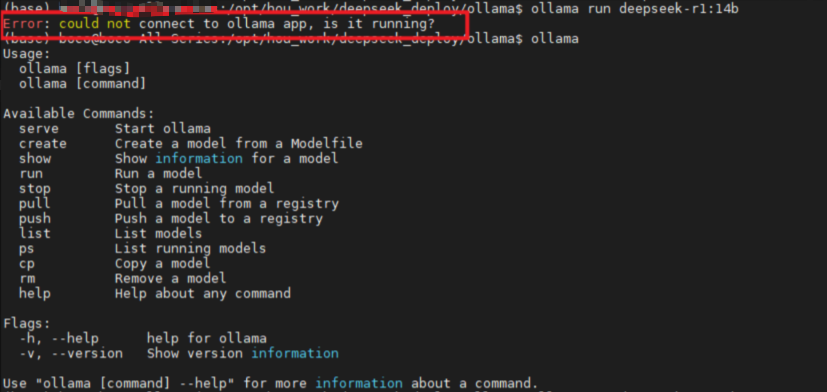

4.1 运行 ollama run deepseek-r1:14b 提示:Error: could not connect to ollama app, is it running?

这个的意思是 ollama 服务未启动,虽然刚刚安装好之后提示我已经正常运行了,所以去 GitHub 上搜了下看看有没有类似的情况

参考 issue:https://github.com/ollama/ollama/issues/2727 所以我们手动启动下服务就行:

sudo systemctl start ollama

sudo systemctl status ollama